前言

随着Xcode26.3的发布,开发者们终于可以在Xcode中直接使用AI来辅助开发了。Xcode支持多种AI模型,包括OpenAI、Claude以及本地部署的模型,让开发者可以根据自己的需求选择合适的AI模型来提升开发效率。

安装本地模型

因为Xcode支持本地部署的AI模型,所以我体验了一下在本地进行部署,然后在Xcode中配置使用。这里我选择了ollama这个工具来部署本地模型,下面是具体的步骤,先安装ollama:

curl -fsSL https://ollama.com/install.sh | sh

这里可以看到ollama支持的模型,https://ollama.com/library

我这里选择的是qwen3-coder:30b,安装命令如下:

ollama pull qwen3-coder:30b

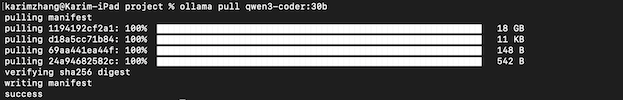

下载完成后可以看到模型已经安装好了:

ollama默认会在本地启动一个服务,监听11434端口,我们可以请求测试一下:

curl http://localhost:11434/api/generate -d '{

"model": "qwen3-coder:30b",

"prompt": "Write a Swift async HTTP request example"

}'

看到成功有返回之后就可以在Xcode中进行配置了使用了。

Xcode配置本地模型

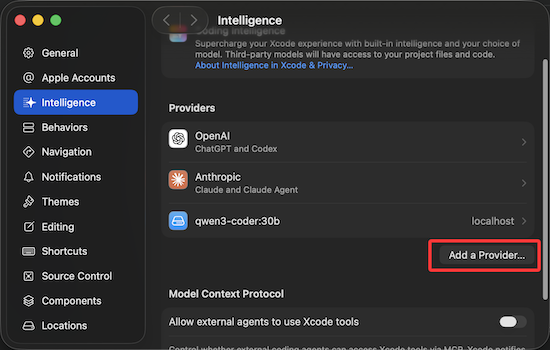

打开Xcode,选择菜单栏的Xcode->Settings,在弹出的设置界面中选择Intelligence,这里可以看到支持OpenAI和Claude,我要演示的本地模型的使用,所以点击Add a Provider...:

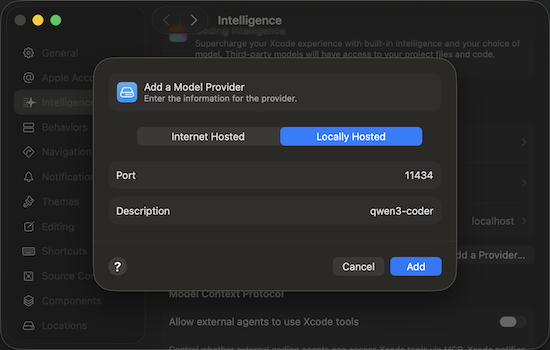

选择Locally Hosted,填写Port为11434和Description后就可以了。

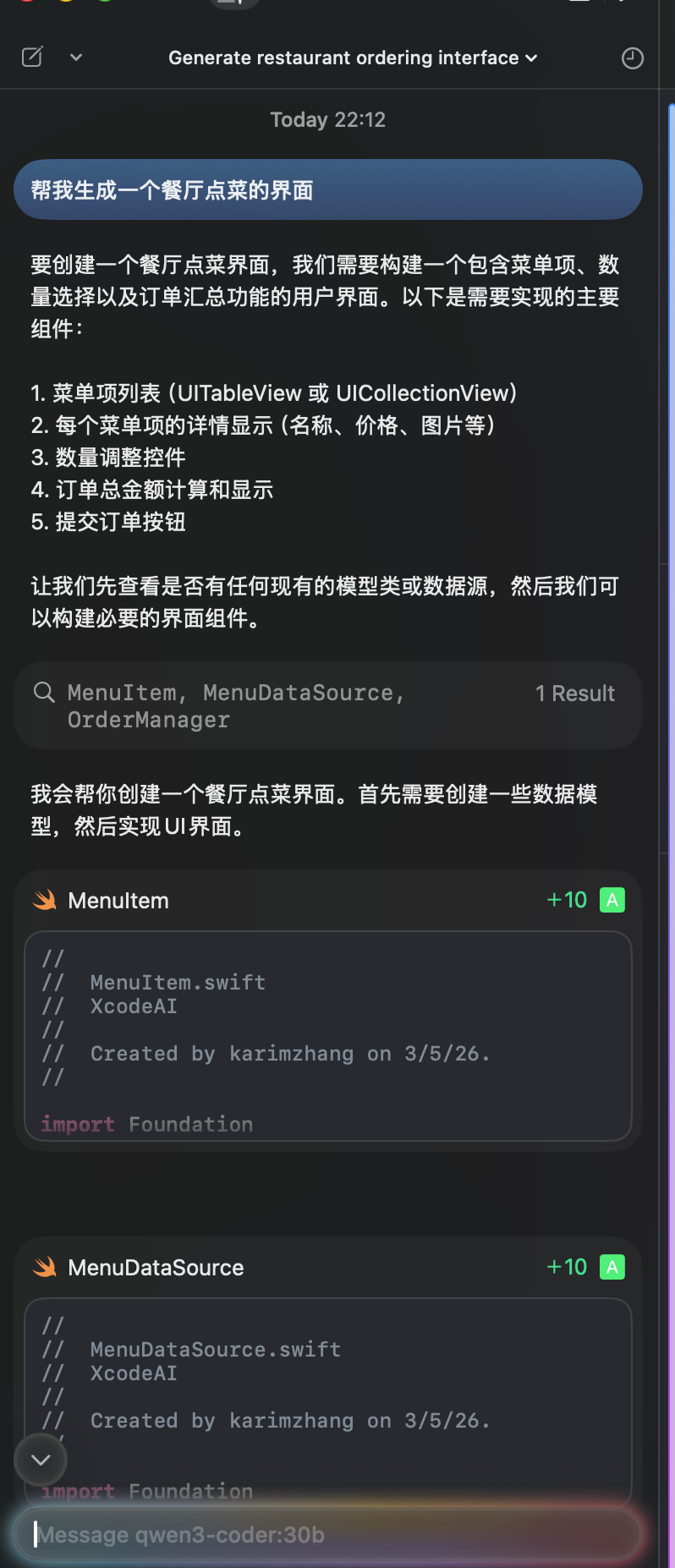

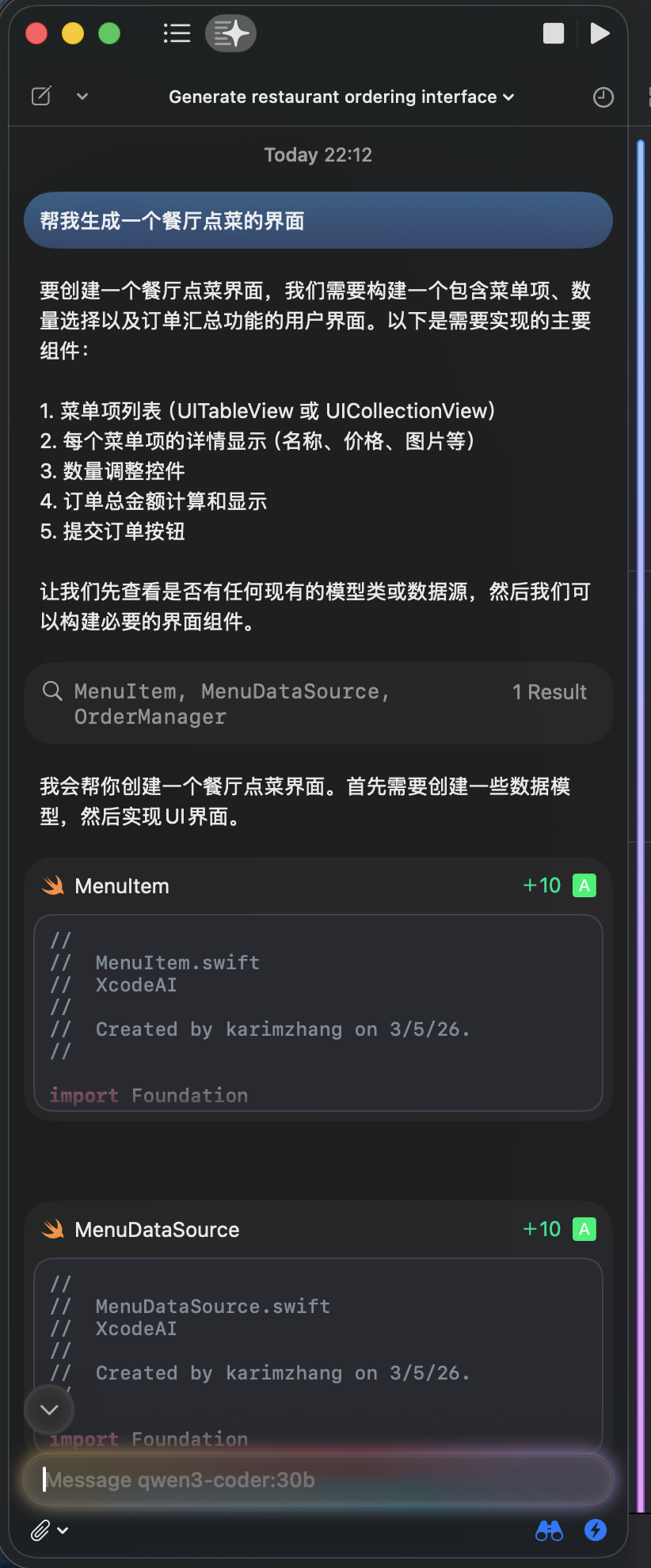

简单的让Xcode使用这个模型写了个demo,效果还不错:

总结

Xcode26.3终于支持了AI,但是目前其实非常有限,仅限于代码生成,连代码补全都不支持,感觉更像是一个独立的AI工具,而不是集成在Xcode中的AI助手,而官方提到的其他功能,在cursor、vscode等工具一样能做,而且别人做的更好,想必Xcode在这还有很长的一条路要走。

参考

Meet agentic coding in Xcode

Ollama

请保持转载后文章内容的完整,以及文章出处。本人保留所有版权相关权利。